Alvaros

.

- Регистрация

- 14.05.16

- Сообщения

- 21.452

- Реакции

- 101

- Репутация

- 204

Меня зовут Игорь Сидоренко, я техлид в команде админов, поддерживающих в рабочем состоянии всю инфраструктуру Домклик.

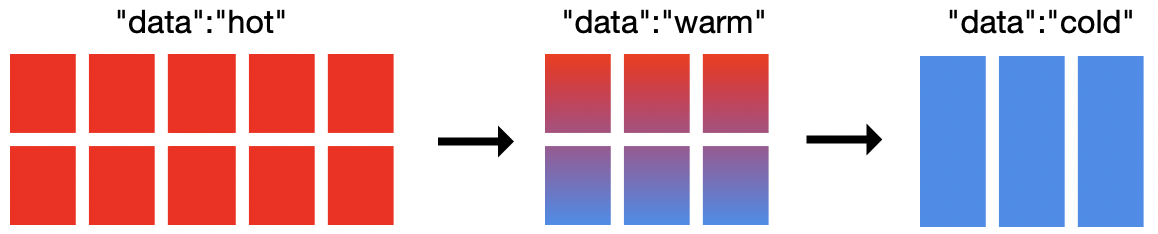

Хочу поделиться своим опытом в настройке распределённого хранения данных в Elasticsearch. Мы рассмотрим, какие настройки на нодах отвечают за распределение шардов, как устроен и работает ILM.

Те, кто работают с логами, так или иначе сталкиваются с проблемой долгосрочного хранение для последующего анализа. В Elasticsearch это особенно актуально, потому что с функциональностью куратора всё было прискорбно. В версии 6.6 появился функционал ILM. Он состоит из 4 фаз:

- Hot — индекс активно обновляется и запрашивается.

- Warm — индекс больше не обновляется, но всё ещё запрашивается.

- Cold — индекс больше не обновляется и редко запрашивается. Информация всё ещё должна быть доступна для поиска, но запросы могут выполняться медленнее.

- Delete — индекс больше не нужен и может быть безопасно удален.

Дано

- Elasticsearch Data Hot: 24 процессора, 128 Гб памяти, 1,8 Тб SSD RAID 10 (8 нод).

- Elasticsearch Data Warm: 24 процессора, 64 Гб памяти, 8 Тб NetApp SSD Policy (4 ноды).

- Elasticsearch Data Cold: 8 процессоров, 32 Гб памяти, 128 Тб HDD RAID 10 (4 ноды).

Цель

Эти настройки индивидуальны, всё зависит от места на нодах, количества индексов, логов и т.д. У нас это 2-3 Тб данных за сутки.

- 5 дней — фаза Hot (8 основных / 1 реплика).

- 20 дней — фаза Warm (

You must be registered for see links4 основных / 1 реплика).

- 90 дней — фаза Cold (

You must be registered for see links4 основных / 1 реплика).

- 120 дней — фаза Delete.

Настройка Elasticsearch

Для распределения шард по нодам нужен всего один параметр:

- Hot-ноды:

~]# cat /etc/elasticsearch/elasticsearch.yml | grep attr

# Add custom attributes to the node:

node.attr.box_type: hot - Warm-ноды:

~]# cat /etc/elasticsearch/elasticsearch.yml | grep attr

# Add custom attributes to the node:

node.attr.box_type: warm - Cold-ноды:

~]# cat /etc/elasticsearch/elasticsearch.yml | grep attr

# Add custom attributes to the node:

node.attr.box_type: cold

Настройка Logstash

Как это всё работает и как мы реализовали эту функцию? Давайте начнем с попадания логов в Elasticsearch. Есть два способа:

- Logstash забирает логи из Kafka. Может забрать чистыми или преобразовать на своей стороне.

- Что-то само пишет в Elasticsearch, например, APM-сервер.

Рассмотрим пример управления индексами через Logstash. Он создает индекс и применяет к нему

You must be registered for see links

и соответствующий

You must be registered for see links

.k8s-ingress.conf

input {

kafka {

bootstrap_servers => "node01, node02, node03"

topics => ["ingress-k8s"]

decorate_events => false

codec => "json"

}

}

filter {

ruby {

path => "/etc/logstash/conf.d/k8s-normalize.rb"

}

if [log] =~ "\[warn\]" or [log] =~ "\[error\]" or [log] =~ "\[notice\]" or [log] =~ "\[alert\]" {

grok {

match => { "log" => "%{DATA:[nginx][error][time]} \[%{DATA:[nginx][error][level]}\] %{NUMBER:[nginx][error][pid]}#%{NUMBER:[nginx][error][tid]}: \*%{NUMBER:[nginx][error][connection_id]} %{DATA:[nginx][error][message]}, client: %{IPORHOST:[nginx][error][remote_ip]}, server: %{DATA:[nginx][error][server]}, request: \"%{WORD:[nginx][error][method]} %{DATA:[nginx][error]

You must be registered for see links

[*]

You must be registered for see links

[*]

You must be registered for see links

[*]

You must be registered for see links

[*]

You must be registered for see links

[/LIST]